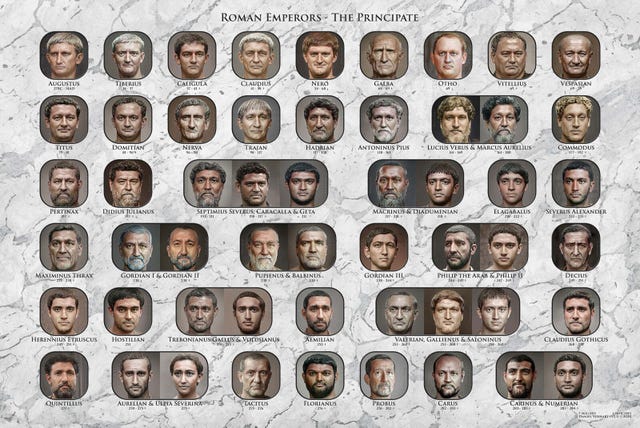

- Daniel Voshart, projektant z Toronto, wykorzystał uczenie maszynowe i Photoshopa do przekształcenia popiersi rzymskich cesarzy w fotorealistyczne obrazy.

- Voshart chciał przedstawić cesarzy tak, jak wyglądaliby pod koniec swojego panowania, nie zważając na żadne choroby, które mogłyby zmienić ich wygląd.

- Artyści byli znani z wyolbrzymiania dobrego wyglądu klasy rządzącej, więc przypuszczalnie te obrazy są bardziej sprawiedliwe.

Artyści historycznie wyolbrzymiali to, jak atrakcyjni byli władcy na swoich portretach i rzeźbach. Angielska królowa Karolina powiedziała to najlepiej w 1795 roku, kiedy opisała moment, w którym po raz pierwszy spojrzała na swojego narzeczonego, króla Jerzego IV: „Uważam, że jest bardzo gruby i w żadnym razie nie tak piękny jak jego portret.”

Teraz projektant z Toronto koryguje niektóre z tych twórczych swobód. Łącząc uczenie maszynowe, Photoshopa i zapisy historyczne, Daniel Voshart przekształcił 54 popiersia rzymskich cesarzy z okresu pryncypatu (od 27 r. p.n.e. do 285 r. n.e.) w fotorealistyczne obrazy.

⏳ Kochasz historię starożytną. Tak jak my. Let’s nerd out nad nim razem.

Originally, Voshart podjął pracę jako projekt kwarantanny rodzaju. „Myślę, że to natura pandemii, która kazała mi myśleć o czymkolwiek innym, a może pociągały mnie chorobliwe szczegóły z życia cesarzy” – mówi Popular Mechanics. „Pracowałem nad serialem sci-fi o 2000 lat w przyszłości, więc może ciągnęło mnie do myślenia o przeszłości.”

Ale Voshart nie mógł przewidzieć, że zamówienia na jego pierwsze odbitki – przedstawiające cesarzy takich jak August, Neron i Decjusz – wybuchną na jego stronie Etsy. „Nie wiedziałem, że odzew będzie tak duży, że zredukuję liczbę godzin pracy, aby zaspokoić popyt” – mówi.

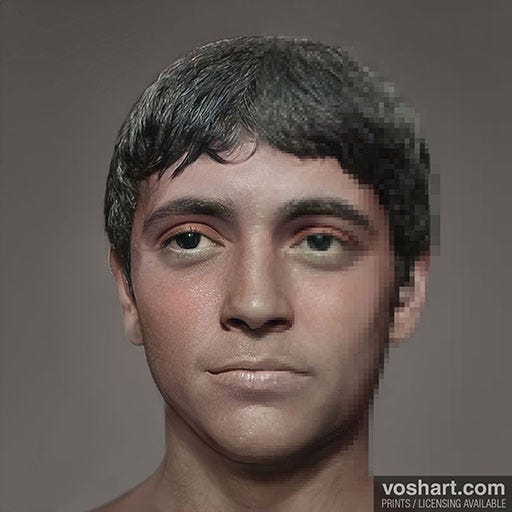

Proces nie był po prostu kwestią wstawiania zdjęć popiersi, aby wypluć z nich jakiś rodzaj idealnej ludzkiej twarzy, mówi Voshart. Aby wygenerować wstępne szkice twarzy każdego cesarza, Voshart w dużej mierze oparł się na narzędziu do uczenia maszynowego o nazwie Artbreeder. To otwarte oprogramowanie wykorzystuje generatywne sieci przeciwstawne (ang. Generative Adversarial Network, GAN) do tworzenia obrazu.

Jeśli to brzmi znajomo, to prawdopodobnie dlatego, że słyszałeś o deepfakes, czyli syntetycznych mediach często wykorzystywanych do nikczemnych celów. GAN, technologia leżąca u podstaw deepfakes, może pomóc algorytmom wyjść poza proste zadanie klasyfikacji danych i przejść do sfery tworzenia danych – w tym przypadku obrazów. Dzieje się tak, gdy dwa GAN-y próbują oszukać się nawzajem, aby myśleć, że obraz jest prawdziwy. Używając tylko jednego obrazu, wypróbowany i przetestowany GAN może stworzyć klip wideo przedstawiający, powiedzmy, Richarda Nixona.

Roman Emperors Merch

Mimo że rzymscy cesarze Vosharta nie są deepfake’ami, dzielą podobne ramy technologiczne – są to po prostu różne zastosowania uczenia maszynowego. Konkretnie, Artbreeder używa NVidea StyleGAN, open-source GAN, który informatycy stworzyli z powrotem w grudniu 2018 roku.

W wirtualnym wykładzie z 30 września na temat „GANs for Good”, Anima Anandkumar, dyrektor badań nad uczeniem maszynowym w firmie NVIDIA, wyjaśnia, jak działa ta technologia. Wykorzystując technikę zwaną uczeniem rozłącznym, GAN może lepiej oddzielać i kontrolować pewne elementy stylu w izolacji, co artyści tacy jak Voshart potrafią naturalnie robić znacznie lepiej niż maszyny.

„Ludzie są w tym świetni”, wyjaśnił Anandkumar podczas wykładu. „Mamy różne koncepcje, których nauczyliśmy się jako niemowlęta i zrobiliśmy to w sposób nienadzorowany, i w ten sposób możemy teraz komponować, i tworzyć zupełnie nowe obrazy lub koncepcje”. W praktyce oznacza to, że użytkownik ma większą kontrolę nad tym, które właściwości obrazu źródłowego chciałby wykorzystać w nowym.

Tapnij tutaj, aby zagłosować

Joel Simon, deweloper, który stworzył Artbreeder, mówi Popular Mechanics, że wszystko sprowadza się do sposobu, w jaki sieci neuronowe programu reprezentują „przestrzeń” w obrazach.

„Kiedy obraz jest 'załadowany’, twarz jest przycinana, a następnie proces wyszukiwania jest wykonywany, aby znaleźć najbliższe miejsce w przestrzeni dla tego obrazu,” wyjaśnia. „Kiedy już jest w tej 'przestrzeni’, łatwo jest 'poruszać się’ poprzez dodawanie lub odejmowanie liczb, które odpowiadają wartościom takim jak wiek lub płeć, tutaj nazywane 'genami’. Tak więc dodając kolor, robi to w bardzo inteligentny sposób, nie tylko poprzez edycję pikseli, ale poprzez poruszanie się w przestrzeni wszystkich twarzy.”

To sprawia, że jest to prostsze dla artysty takiego jak Voshart, aby przesłać dane szkoleniowe – w tym przypadku około 800 próbek popiersi rzymskich cesarzy – aby wymyślić hiperrealistyczną twarz z mniejszą ilością artefaktów lub nieprawidłowości wprowadzonych przez oprogramowanie.

Wciąż, Voshart miał znaczną ilość pracy na swoich rękach, nawet po użyciu oprogramowania Artbreeder. W jego fazie testowej, przed wyprodukowaniem twarzy Cesarza Rzymskiego, które są przedstawione w jego ostatecznych wydrukach, wyniki były obarczone nieprawidłowościami.

„Rezultat wychodzi z wieloma dziwnymi artefaktami i ma tendencję do morfingu cech z powrotem do pewnego rodzaju przeciętnej twarzy, co jest przeciwieństwem tego, co chcesz, gdy chcesz zachować interesujący wyraz”, mówi Voshart. „Mój proces polegał bardziej na pobraniu z Artbreeder, zmodyfikowaniu w Photoshopie i powtórzeniu procesu poprzez załadowanie z powrotem do Artbreeder”.

Nawet jeśli usunięcie wad w wygenerowanych obrazach może być bólem głowy, Voshart mówi, że nie ma „odległej szansy”, że mógłby wykonać pracę bez mocy uczenia maszynowego.